TikTok a pour projet de supprimer automatiquement les vidéos qui violent ses politiques en matière de contenu violent, pour adultes et illégal, afin de rendre la modération plus rapide et plus efficace à mesure que le réseau social se développe. Actuellement, TikTok s’appuie sur une équipe de sécurité basée aux États-Unis, qui est chargée de vérifier chaque vidéo signalée par les utilisateurs ou par un système automatisé.

Cependant, cela peut prendre beaucoup de temps, et TikTok prévoit donc de donner plus de pouvoir au système de modération automatisé. Dès les prochaines semaines, l’entreprise a confirmé aujourd’hui qu’elle permettra au système de supprimer automatiquement certains types de contenus qui violent les règles.

” Le système automatisé sera réservé aux catégories de contenu pour lesquelles notre technologie présente le plus haut degré de précision “, a déclaré Eric Han, responsable de la sécurité de TikTok aux États-Unis, ” à commencer par les violations de nos politiques en matière de sécurité des mineurs, de nudité et d’activité sexuelle des adultes, de contenu violent et graphique, ainsi que d’activités illégales et de biens réglementés “.

Selon M. Han, le système amélioré a déjà été testé sur d’autres marchés et il va maintenant être introduit aux États-Unis et au Canada. Pour les utilisateurs, il ressemblera à une entreprise normale, avec la capacité de faire appel des retraits de vidéos – qu’ils soient automatisés ou manuels – et de signaler les violations potentielles de la politique de contenu. Les capacités et la précision du système devraient s’améliorer avec le temps, selon Han.

Toutefois, il ne s’agit pas seulement de gérer un nombre croissant de téléchargements sur TikTok. Une attention croissante a été accordée à l’impact sur la santé mentale de la modération du contenu par des équipes de personnes sur les réseaux sociaux, ainsi qu’à l’effet cumulatif de la vision répétée de photos et de vidéos violentes, explicites ou autrement dérangeantes.

Facebook, YouTube et d’autres entreprises ont été critiquées pour ne pas avoir accordé suffisamment d’attention à leur personnel de modération, dont un grand nombre sont des employés contractuels qui ne sont pas soumis aux politiques de protection supposées.

” Au-delà de l’amélioration de l’expérience globale sur TikTok, nous espérons que cette mise à jour soutiendra également la résilience au sein de notre équipe de sécurité en réduisant le volume de vidéos angoissantes visionnées par les modérateurs et en leur permettant de passer plus de temps dans des domaines hautement contextuels et nuancés tels que l’intimidation et le harcèlement, la désinformation et les comportements haineux “, suggère Han.

Aux endroits où le système amélioré a déjà été déployé, TikTok indique que le taux de faux positifs pour les suppressions automatiques est de 5 %. Les demandes de recours contre les suppressions par les créateurs sont restées constantes, par rapport à l’époque où le processus était géré manuellement.

Mode de fonctionnement des violations de contenu de TikTok

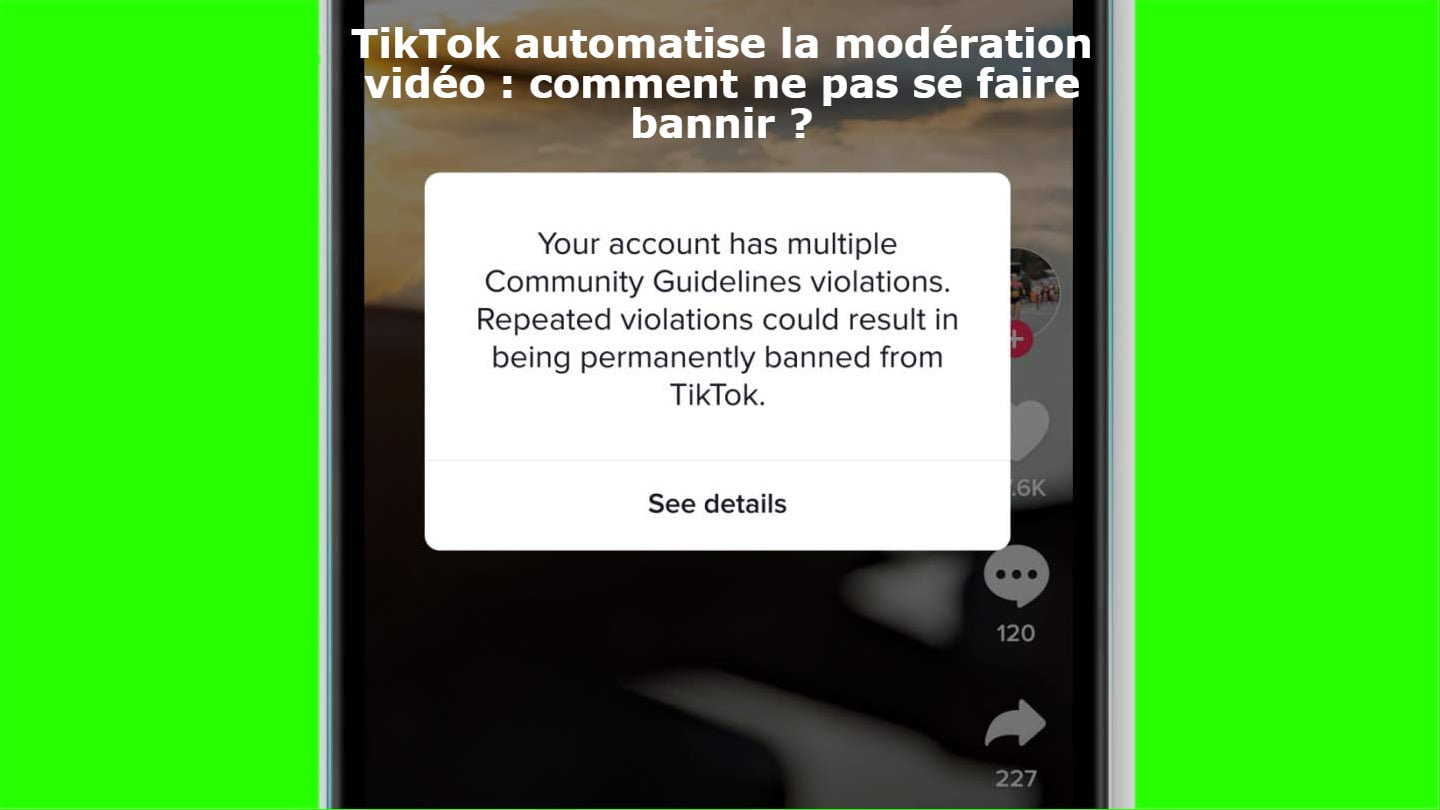

Tout comme d’autres services, TikTok propose une série de niveaux d’escalade pour les violations de contenu auxquelles les créateurs sont confrontés. Outre le nouveau système de modération automatisé, il s’efforce également de rendre plus claires les répercussions potentielles d’une violation du système.

Une première violation donne lieu à un avertissement dans l’application TikTok. Les violations suivantes suspendront la capacité du compte à télécharger une vidéo – ou à commenter ou même à modifier son profil – pendant 48 heures. La durée exacte dépendra à la fois de la gravité de la violation et de toute violation antérieure.

Le compte peut également être limité à une expérience de lecture seule pendant 72 heures ou jusqu’à une semaine complète. De cette manière, les utilisateurs peuvent uniquement visualiser les vidéos, mais ne peuvent pas les publier, ni les commenter.

Au bout de plusieurs infractions, une notification avertit l’utilisateur que “son compte est sur le point d’être interdit”, précise M. Han. S’il continue à avoir le même comportement, le compte sera définitivement supprimé.

Bien entendu, s’il s’agit d’une violation de la “politique de tolérance zéro”, qui inclut des éléments tels que la publication de matériel pédopornographique, son compte sera automatiquement supprimé. TikTok peut également bloquer complètement un appareil dans de telles circonstances, empêchant ainsi qu’il soit utilisé pour créer de nouveaux comptes.